Fino a qualche tempo fa, gli unici sensori alla portata di noi mortali erano costituiti da un contenitore metallico a tenuta di luce in cui era avvolta una lunga striscia di plastica sulla quale si potevano imprimere fino a ben 36 immagini. Esatto, stiamo parlando della pellicola fotografica. Senza dilungarci troppo in mielosi e nostalgici ricordi da camera oscura, la pellicola era, appunto, un supporto rivestito da uno o più strati di gelatina (a seconda che si trattasse di pellicola b/n o colore) contenente il materiale fotosensibile vero e proprio: cristalli di alogenuro d’argento che, a livello atomico, si trasformavano in argento metallico quando esposti alla luce proveniente dalle lenti di un obiettivo formando la cosiddetta “immagine latente”.

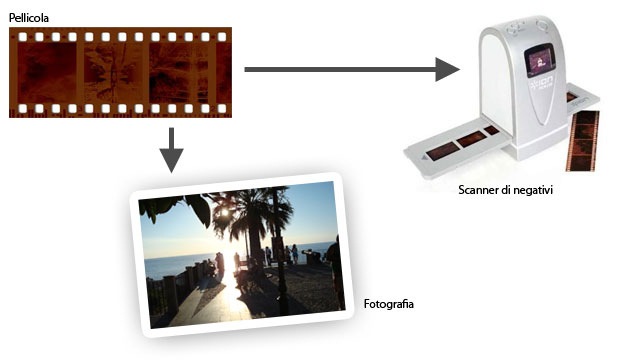

Perchè questa potesse rivelarsi, dovevamo sottoporre il rullino ad un successivo trattamento di sviluppo. Una volta ottenuto il negativo (o positivo, a seconda del tipo di pellicola e trattamento) si poteva ottenere una stampa o una scansione.

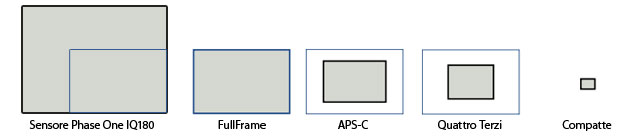

Oggi, grazie alle capacità di un ingegnere dell’azienda che dominava il mercato delle pellicole (Eastman Kodak), i sensori fotografici digitali hanno quasi completamente sostituito la pellicola in ogni ambito, equipaggiando una miriade di dispositivi, dal telefonino al megagalattico dorso Phase One IQ180 con sensore da 80 (dicasi “ottanta”) Megapixel.

Ma come funzionano questi sensori e come hanno fatto a cambiare così radicalmente le nostre abitudini fotografiche? Cercando di snellire quanto possibile i concetti e azzardando anche un breve parallelo con la pellicola, possiamo dire che se questa era composta da uno o più strati di materiale sensibile alla luce, oggi è un insieme di recettori fotosensibili collocati ordinatamente su di una superficie bidimensionale.

Sorvolando – per il bene della scorrevolezza della lettura – sul tipo di tecnologia dietro questi foto recettori, CCD o CMOS, possiamo dire che, nella stragrande maggioranza dei casi, ciascuno di essi contribuisce alla formazione dell’immagine con dei pixel. Per essere più precisi, il sensore misura la luce che passa attraverso le lenti degli obiettivi e ciascuno dei suoi elementi produce una carica elettrica proporzionale che indica uno specifico valore di luminanza, senza peraltro essere capace di registrare alcuna informazione sul colore. Come si fa, allora, ad ottenere un’immagine a colori visto che il sensore vede solo in bianco e nero o, più esattamente, in scala di grigio?

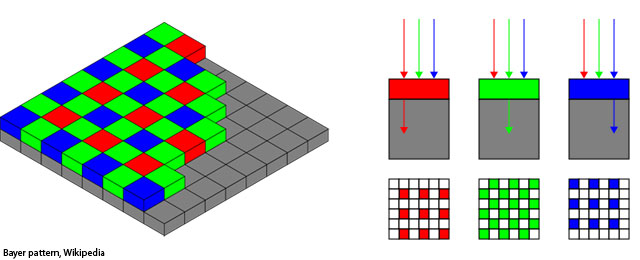

Molto ingegnosamente si pone davanti al sensore uno strato che alterna dei filtri con i colori primari (rosso, verde e blu) in modo da separare le singole componenti cromatiche. Nell’arrangiamento inventato da un certo signor Bayer (ancora una volta un dipendente Kodak) il verde è presente in misura doppia rispetto al rosso e al blu. Se vi state domandando il perché di questa proporzione, dipende dal fatto che i nostri occhi sono più sensibili al verde. Per questo anche se ci sono altri schemi possibili il Bayer è quello più usato.

Le informazioni grezze catturate dal sensore vengono trasformate in una immagine digitale a colori grazie al processo di demosaicizzazione (dall’inglese “demosaicing”). Per ogni singolo pixel sono necessari i dati delle tre componenti cromatiche e questi vengono ricostruiti proprio in base allo schema utilizzato dal sensore. Questo processo può avvenire direttamente nella fotocamera (quando salva in JPG o TIFF) oppure si può demandare a specifici software per computer destinati al post-produzione (Aperture o Lightroom ne sono un esempio).

Nel prossimo appuntamento metteremo da parte la teoria per concentrarci su aspetti più concreti per tirar fuori il meglio dai nostri sensori. Nel frattempo consiglio vivamente la lettura del precedente articolo: “Perché conviene sempre scattare in RAW.

Oltre a richiedere rispetto ed educazione, vi ricordiamo che tutti i commenti con un link entrano in coda di moderazione e possono passare diverse ore prima che un admin li attivi. Anche i punti senza uno spazio dopo possono essere considerati link causando lo stesso problema.

Oltre a richiedere rispetto ed educazione, vi ricordiamo che tutti i commenti con un link entrano in coda di moderazione e possono passare diverse ore prima che un admin li attivi. Anche i punti senza uno spazio dopo possono essere considerati link causando lo stesso problema.