Si dice che esistano due approcci al backup, quello di chi lo esegue regolarmente e quello di chi non ha mai perso un dato. Per ‘funzionare’ l’esempio estremizza i due comportamenti, ma esiste un importante fondo di verità rispetto al fatto che le persone più sensibili ed attente nel backup, sono proprio quelle che hanno perso documenti importanti almeno una volta nella loro vita. Ecco perché la direzione presa da Apple con Time Machine è stata quella giusta: fornire un metodo di backup così semplice che anche i più pigri possono giovarne.

Abbiamo anche avuto modo di verificare che Lion porterà importanti migliorie sulla salvaguardia dei dati. Meccanismi come istantanee e versioni aumenteranno in modo considerevole l’efficienza e la sicurezza nella preservazione del nostro lavoro, tutto senza richiedere il minimo sforzo da parte dell’utente. Escludendo chiaramente i guasti hardware, che purtroppo continueranno ad avere il medesimo impatto (negativo). Ed è proprio nell’hardware e nella sostanziale differenza strutturale tra hard disk tradizionali ed allo stato solido, che si devono ricercare i motivi che portano a notevoli variazioni nella possibilità di recupero dei dati.

Di norma i file passano dal finder al cestino, finché questo non viene svuotato. Ma anche successivamente è altamente probabile riuscire a recuperare i byte che lo componevano analizzando la superficie del disco. Il motivo è che l’eliminazione non azzera fisicamente lo spazio, ma lo imposta semplicemente in una condizione “neutra”, un po’ come un purgatorio dei bit. Per cui se lo spazio non viene sovrascritto da altri dati, un semplice software come Disk Drill ha la capacità di riportare in vita file apparentemente dispersi.

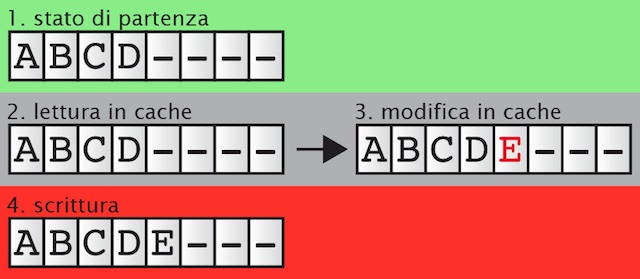

Parlando molto spesso di SSD però, ho evidenziato che la natura stessa delle celle di memoria richiede la scrittura “in blocco” e che quando ogni cella diventa parzialmente utilizzata (cosa normale con l’uso), si può andare incontro a rallentamenti dovuti alle cancellazioni e/o letture da eseguire prima di ogni scrittura. Volendo fare un esempio di modifica parziale, se una cella riporta le informazioni ABCD—- e vogliamo aggiungere E, il disco dovrà prima leggere la condizione iniziale, poi effettuare la modifica ed infine scrivere.

La stessa cosa vale anche nel caso di cancellazioni, per questo esistono funzioni come TRIM o il Garbage Collector, che pur agendo diversamente tentano allo stesso modo di mantenere alta l’efficienza liberando preventivamente lo spazio e in alcuni casi organizzando anche le scritture in modo da arginare la caduta di prestazioni. Ma sapete cosa significa avere un sistema che passa al setaccio il nostro disco per ripulire in modo definitivo lo spazio liberato a seguito di cancellazioni logiche?

Esatto: il recupero con scansioni approfondite diventa estremamente più difficoltoso.

La mia impressione è però che Apple stia tentanto di anticipare il problema con la soluzione. Le già citate funzioni di Lion viste nei nostri Spoiler, sembrano destinate a sopperire queste sopraggiunte difficoltà memorizzando in modo autonomo file cancellati e addirittura versioni precedenti degli stessi, fornendo modalità di recupero totalmente integrate ed accessibili, che non dipendono dunque dalla natura fisica del disco.

Ma c’è sempre un però a dimostrare che ogni medaglia ha il suo rovescio.

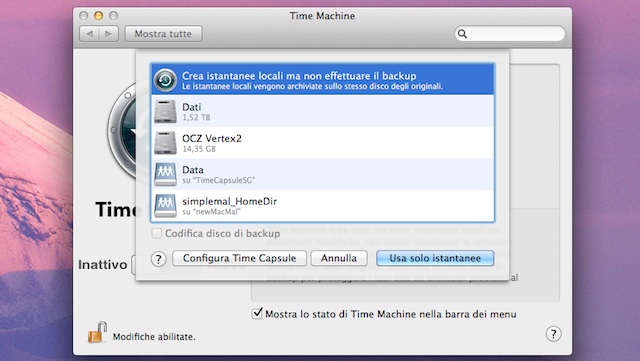

L’utente mau che sta provando Lion da qualche giorno su un MacBook Air con SSD da 64GB, mi ha segnalato che a fronte del suo utilizzo di 34,6GB, risultava invece un totale di 55,4GB. I vari sistemi di prevenzione sono ‘tarati’ per autosostenersi eliminando salvataggi precedenti, ma la voglia di semplicità ha portato (come già accaduto per Time Machine) all’assenza quasi totale di opzioni personalizzabili. Probabilmente vedremo in futuro apparire anche dei tool di terze parti e delle opzioni modificabili da terminale, ma allo stato attuale l’unica opzione per l’utente è quella di eliminare manualmente le vecchie istantanee liberando spazio o addirittura disattivando tale funzione. Ma in questo secondo caso però, tutta la protezione viene vanificata e si ritorna ad essere ‘dipendenti’ da Time Machine e dischi esterni (o da altri sistemi di backup di terze parti ovviamente).

Ci muoviamo dunque a grandi passi verso quello che, senza timore di smentite, sarà il futuro della memorizzazione anche in ambito privato. E se i produttori devono riuscire ad abbassare i costi dell’hardware in virtù dell’allargamento del mercato (magari senza ricorrere a riduzioni qualitative come nel caso di OCZ), il reparto software e sistemi operativi deve dimostrarsi pronto sia a sfruttare i vantaggi derivanti dalla nuova tecnologia che a ridurre i potenziali aspetti negativi.

Ci troviamo in un periodo di passaggio in questo momento e per quanto io faccia ricerche in tal senso, ancora molti aspetti risultano non troppo chiari e definiti. Molto spesso mi si pongono domande alle quali non è ancora possibile fornire risposte certe, ma per quanto possibile mi sono impegnato nell’analizzare e testare queste tecnologie sul fronte umano, nel tentativo di fornire una visione più pragmatica e comprensibile dell’andamento globale, ma soprattutto di quei tecnicismi che ogni tanto è bene mettere da parte al fine di rendere gli argomenti comprensibili e le scelte più consapevoli.

Oltre a richiedere rispetto ed educazione, vi ricordiamo che tutti i commenti con un link entrano in coda di moderazione e possono passare diverse ore prima che un admin li attivi. Anche i punti senza uno spazio dopo possono essere considerati link causando lo stesso problema.

Oltre a richiedere rispetto ed educazione, vi ricordiamo che tutti i commenti con un link entrano in coda di moderazione e possono passare diverse ore prima che un admin li attivi. Anche i punti senza uno spazio dopo possono essere considerati link causando lo stesso problema.